人工智能(AI)现在似乎无处不在了,至少,关于它的讨论铺天盖地。

我们有了这些极其流畅的聊天机器人,还有那些感觉如同魔法一般的图像生成器,未来似乎已经降临。但,果真如此吗?如果你能拨开那些炫目的“演示”迷雾,你可能会注意到,今天的大多数 AI 其实更像一个困在缸中的大脑。它能就几乎任何事情侃侃而谈,但却做不了太多实事。

如果你真的尝试用这些大语言模型(LLM)去构建一些有意义的东西,一些需要与其训练数据之外那个真实、混乱、动态的世界互动的东西,你很快就会碰壁。一堵数字化的、厚重且令人沮丧的墙挡在你的身前。这些在海量文本和代码上训练出来的模型,看似无所不知,却又矛盾地被隔绝着。它们知道关于你的日历、知道关于航班价格、知道关于你公司的销售数据,但若没有精心设计的、定制化的“脚手架”,它们无法可靠地查询最新信息、预订机票、查询实时数据库,甚至连在你自己的电脑上整理文件都做不到。

这感觉就像你拥有一个天才顾问,但他只能通过一个层层过滤的对讲机与你沟通,而且没有手。他能基于已知信息给出绝妙的见解,可一旦你让他去拿份最新报告或执行一个简单命令,整个系统就可能瘫痪。为了让 AI 做成任何事,你,作为构建者,最终会深陷于繁琐、脆弱的工程泥潭。

纠缠不清、脆弱不堪的烂摊子

为什么打通这层隔阂如此令人痛苦?因为就目前而言,将 AI 连接到任何外部事物,无论是 SaaS 工具的 API、内部数据库,还是一个文档文件夹,都是一项定制化的工作。

想象一下,如果每一款外设(每个制造商的每种键盘型号、每台打印机、每个外部驱动器)都需要一个完全独特的、定制加工的物理端口,还需要一个工程师团队从零开始编写专用的软件驱动程序,只为了你的特定设置,那会怎样?那将是一场噩梦。令人沮丧的是,这非常接近当前实用 AI 交互的现状。

这里遍布着一次性的 API 集成、脆弱的 Python 脚本,以及随时可能爆发的安全漏洞。想让你的 AI 助手检查邮件、更新系统、并查询互联网?你很可能需要构建并(关键是)维护三个完全独立的、极其“娇气”的连接桥梁。当其中某个外部 API 不可避免地发生变化时(它们总是会变),你的桥梁就断了,你那聪明的 AI 瞬间又变得愚笨。这不仅效率低下,更是对创新征收的重税。它使得构建健壮的、具备多种能力的 AI 应用变得极其昂贵和充满风险,尤其是对小团队而言。这种纯粹的复杂性阻碍了我们轻松地组合工具——让 AI 使用工具 A,然后将其结果输入工具 B——而这对于处理非简单任务至关重要。

人类很久以前就通过拥抱标准摆脱了这种复杂性陷阱。想想 USB,你不用担心新买的鼠标能否与你的笔记本电脑配合使用,不论制造商是谁,你只需插上它。标准处理了底层的复杂细节,将其抽象化了。

我们迫切需要为 AI 交互建立类似的抽象层,一种通用的语言,一个万能的适配器。

MCP:AI 界的 USB-C?

正是在这里,由 Anthropic 公司倡导的模型上下文协议(Model Context Protocol, MCP)的想法,开始听起来不再像是学术术语,而更像是一条潜在的生命线。先忘掉它那花哨的名字,把它想象成一次严肃的尝试,旨在为 AI 创建类似 USB-C 的东西,或者更根本地说,类似于软件与数字系统对话的标准方式。

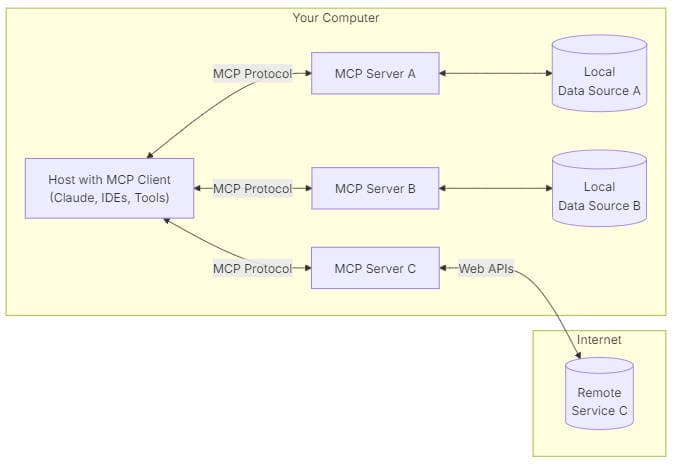

其核心思想异常简洁:定义一个标准协议,让 AI 应用(“客户端”,如你的聊天机器人或代理)能够动态地发现外部资源(“服务器”,代表工具、数据库、文件系统、API 等)并与之交互。

AI 不再需要预先编程去了解每个特定 API 怪异的认证方案或数据格式的细节,它只需要学习一种标准的通信方式:MCP。MCP 服务器则充当实际工具或数据源的中间人,一个标准化的包装器,它以一致的格式宣告自己的能力。

想象一下交互过程:

- 发现(Discovery): AI 应用在需要外部帮助时,询问一个(或一系列)MCP 服务器:“你能为我做什么(工具 Tools)?你拥有什么信息(资源 Resources)?”这就像问一个新外设:“你是什么?你能理解哪些命令?”

- 标准化响应(Standardized Response): MCP 服务器使用标准的 MCP 格式回应:“我可以访问这些类型的文件,”或者“我提供这些操作:

search_contacts(query)、send_email(to, subject, body)。” - 执行/查询(Action/Query): AI 理解了用户的需求和服务器宣告的能力后,决定调用某个工具或请求数据,同样使用确定好的 MCP 请求格式。

- 标准化结果(Standardized Result): MCP 服务器执行操作(通过使用其“母语”与底层工具/数据库对话),并将结果返回给 AI。

突然间,那个纠缠不清的烂摊子开始变得可以梳理了。AI 不需要关心服务器如何搜索联系人,只需要知道它能够搜索,以及如何通过 MCP 去请求。

- 秩序取代混乱: 只需实现一个协议,学习一种交互模式。

- 解耦创造灵活性: AI 应用与底层工具的具体实现解耦。更换邮件服务商?只需将 AI 指向该服务商新的 MCP 服务器(假设存在)。核心 AI 逻辑可能完全无需更改。

- 集成极大简化: 为你的工具构建一个 MCP 服务器(适配器),然后它可以被任何兼容 MCP 的 AI 使用,这比当前每个人到处建立自定义连接的模式具有巨大的杠杆效应。

涟漪效应:重塑 AI 自身

好吧,更简便的集成对构建者来说是个巨大的胜利,它降低了创建真正有用的 AI 应用所需的“启动能量”。但像 MCP 这样的标准所带来的真正深刻影响,其涟漪效应要深远得多。这不仅仅是整理当前的混乱局面,更是可能从根本上改变 AI 的能力及其构建方式。

首先,那些显而易见的应用变得切实可行,而不仅仅是研究项目。能够可靠地管理你的通信、跨多个服务协调旅行预订、通过查询数据库和电子表格执行复杂数据分析、然后执行后续行动的 AI 代理,这将从脆弱演示的领域,走向可能稳健可靠的产品。这是 AI 从一个花哨的检索系统,转变为一个能干的合作者或助手,一个真正的行动者。

但接下来是那个不那么明显,却更具有革命性意义的推论:MCP 或许会从本质上革新训练那些能与现实世界互动的 AI 模型的方法。

目前,教 AI 使用工具是一件棘手的事情。你要么需要精心设计的“提示工程”(prompt engineering),基本上是用基于文本的指令来“哄骗”模型,但这在面对微小变化时常常失效。要么你可能使用强化学习或微调,这需要大量展示 AI 与那个特定 API 或工具正确交互的数据集。这既昂贵又耗时,而且扩展性差(教它一个新工具往往需要全新的训练过程)。

有了像 MCP 这样的标准,训练目标可以发生戏剧性的转变。与其教模型去学习上千种不同 API 的怪癖,不如专注于教它掌握 MCP 这种统一的语法和词汇。你训练它去:

- 理解关于工具和资源的标准化描述。

- 推理判断何时需要使用外部能力。

- 构建正确的请求来调用该能力。

- 理解并基于标准化的响应采取行动。

训练数据本身可以变得更加抽象和通用。不再是无穷无尽的原始 API 调用示例,你可以专注于生成展示这种模式的数据:用户目标 -> 推理轨迹 -> MCP 请求 -> MCP 响应 -> 最终答案/行动。这就像教人使用标准键盘和鼠标的通用原则(指向、点击、输入、读取反馈),而不是死记硬背他们可能遇到的每一台特定机器的独特按钮序列。

这种标准化使得“使用外部工具”这项关键技能变得具有更强的泛化能力。一旦学会了 MCP 的交互模式,AI 就有可能与任何提供 MCP 服务器的工具进行交互,即使是那些它从未明确训练过的工具!它极大地降低了向模型注入“世界交互”能力的成本和复杂性。这不仅仅是渐进式改进,这可能是我们在创造能够行动的代理(agent)方面的一次潜在的相变。

再想想生态系统的效应。如果 MCP 成功推广,你可以预见到 MCP 服务器的“寒武纪大爆发”。从 SaaS 巨头到独立开发者都可以为他们的工具或数据源构建并提供一个 MCP 适配器。需要让你的 AI 与某个晦涩的科学仪器或遗留的内部系统对话?为它构建一个 MCP 服务器。这创造了一个 AI 能力的市场或注册中心,降低了工具提供商让其产品“AI 就绪”的门槛,也让 AI 应用构建者更容易发现和集成他们需要的能力。这促进了互操作性,可能减少厂商锁定(如果你不喜欢某个 AI 模型,但它支持 MCP,你也许可以换用另一个支持 MCP 的模型,而无需重建所有工具连接),并激发了边缘创新。

大棋局:标准、战略与风暴

当然,这个充满希望的未来并非板上钉钉。MCP 本质上是在争取建立一个标准,而标准之争是出了名的复杂、充满政治色彩且进展缓慢,而采用率决定一切。

Anthropic 正以开源的方式推动它,这很明智,标准往往在中立性和社区认同的基础上茁壮成长。但其他主要的 AI 实验室(Google、Meta)会拥抱它、改造它,还是推出自己相互竞争的标准?(最近 Qwen、OpenAI 都在陆续增加支持)他们的动机是什么?支持一个通用标准可能会让连接层商品化,将价值转移到别处。抵制它则可以维持他们自有工具使用生态系统的锁定(比如 Google 的 Vertex AI Extensions)。

工具供应商和 SaaS 公司也面临自己的权衡。构建 MCP 服务器需要投入精力,潜在的好处(接触更多 AI 客户端)是否值得这份投入,尤其是在早期客户端采用率尚不确定的时候?这是经典的“鸡生蛋还是蛋生鸡”问题。服务器需要客户端才有用;客户端需要服务器才值得支持该协议。

此外,还有那些不容忽视的技术和安全障碍。

- 安全性: 这是房间里的大象。通过 MCP 赋予 AI(尤其是自主代理)代表你行动的能力,既强大又危险。你如何实现细粒度的权限控制?如何防止 AI 被欺骗(通过提示注入或恶意的 MCP 服务器响应)执行有害操作?想象一下一个 AI 通过 MCP 接入了你的邮件、日历、代码库以及金融账户。安全模型必须绝对坚不可摧,可能需要对敏感操作进行用户确认、严格的沙箱环境以及健壮的认证/授权机制。一次重大的安全事故就可能给整个标准的前景蒙上阴影。

- 性能: 交互需要快速。MCP 这一层能否在不增加不可接受的延迟的情况下提供必要的能力,特别是对于实时对话代理而言?

- 演进: 标准能否优雅地演进以满足未来的需求?多模态数据(与图像、音频交互)、长期记忆访问、更复杂的状态管理。

我们还需要明确 MCP 的范围。目前可见的是,它主要旨在标准化与数字世界的交互,比如:API、数据库、文件。虽然它可以间接影响物理世界(例如,通过 MCP 调用控制智能家居设备的 API),但它暂时并不是用于机器人技术或直接硬件控制的协议,那很可能是另一个层面的复杂性。

超越协议:行动的智能

那么,MCP 是那个最终答案吗?历史表明,第一个被提出的标准并不总是最终胜出的那个。也许 MCP 本身会演变,或者会出现竞争者,又或者我们会看到各种想法的融合。但是,MCP 所解决的问题——即 AI 与外部世界之间迫切需要一座标准化桥梁——是绝对真实且至关重要的。

没有像 MCP 这样的东西,AI 就有风险一直是一种引人入胜但根本上受限的技术,一个永远被困在玻璃后面的聪明对话者。我们将继续构建脆弱、昂贵、一次性的解决方案,限制了可能实现的范围和健壮性。

而有了一个成功的标准,无论是 MCP 还是别的什么,我们就解锁了让 AI 真正融入我们数字工具和工作流的潜力。不再仅仅是被动的信息来源,而是作为积极的参与者、能干的助手和自主的代理,能够自主感知、推理并行动。

这关乎为下一代 AI 铺设必要的底层管道。这也许不是构建未来最光鲜亮丽的部分,但没有这些标准的管道、连接器和阀门,智能就仍然被堵塞着。MCP,或最终胜出的那个标准,不仅仅是一份技术规范;它是对下一代 AI 应用形态的一次押注,是真正构建它们所必需的关键拼图。它是 AI 从纯粹智力走向实践行动者这盘宏大棋局中的关键一步,是关乎将人工智能从“思考机器”转变为“行动机器”的枢纽。